این فناوری جهت ترکیب و قرار دادن تصاویر و فیلم های موجود بر روی تصاویر یا فیلم های مورد نظر با استفاده از تکنیک یادگیری ماشین تحت عنوان “شبکه مشارکتی مولد” (GAN) (کلاسی از یادگیری ماشین) بکار می رود .

ماه نوامبرِ سال ۲۰۲۰ میلادی است و درست چند روز تا آغاز رأیگیری انتخابات ریاستجمهوری ایالات متحده آمریکا فاصله داریم. مردم، خود را برای شرکت در انتخابات آماده میکنند که بهناگهان ویدئویی عجیب و بهتآور در سراسر اینترنت منتشر میشود. همه درنهایت بهت و حیرت، نامزد پرسروصدا و احتمالاً محبوبشان را مشاهده میکنند که از تشخیص سرطان بدخیم توسط پزشکانش خبر میدهد؛ «من برای رهبری بیشازاندازه ناتوان و بیمار هستم؛ لطفاً به من رأی ندهید.»

هیچکس نمیداند که چه بلایی بر سرِ آینده کشور خواهد آمد. درحالیکه گمانهزنیها درباره بیماری آقای رئیسجمهورِ احتمالی شروع شده، خبری دیگر در رسانههای اجتماعی مثل بمب صدا میکند که بهمراتب از خبر پیشین شوکهکنندهتر است.

اینطور که بهنظر میرسد، یک ملت بازیچهی دستِ یکسری افرادِ ناشناس شدهاند؛ بله درست حدس زدهاید، هیچ سرطانی در کار نبوده و تمامِ اتفاقاتِ ویدئو موردبحث، بهصورت مصنوعی و توسط هوش مصنوعی درست شده است. عدهای همچنان در شوک قرار دارند و نمیتوانند اتفاقاتِ روزهای گذشته را هضم کنند؛ درحالیکه گروهی دیگر از مردم، چنین خبری را تغییر نظر سریع آقا یا خانم نامزد بهحساب میآورند.

برداشتها هرچه که باشد، دیگر کار از کار گذشته و سرنوشت یک کشور، یا بهتر است بگوییم سرنوشت یک جهان در مسیرِ دیگری قرار گرفته است.

سناریوی بالا اگرچه درظاهر تخیلی بهنظر میرسد، اما باوجود پدیدهای جدید بهنام دیپفیک، میتوان بهوقوعپوستنِ این تخیل را در دنیای واقعی متصور شد.

در دهه ۱۹۷۰ تا ۱۹۸۰ میلادی، شرکتی با نام Memorex در حوزهی تولید نوارهای کاست فعالیت میکرد. در تمام کمپینهای تبلیغاتی این شرکت، همواره یک جملهی خاص تکرار میشد: «آیا این صدای واقعی است یا Memorex چنین کیفیتی دارد؟»

با گذشت حدود ۴۰ سال از آن زمان، اکنون باری دیگر در موقعیتی مشابه قرار گرفتهایم؛ بااینتفاوت که اکنون موضوع بحث دیگر بهاندازهی کیفیت نوارکاست و زندهبودن صدای منتشرشده از آن، پیشپاافتاده نیست؛ بلکه حالا باید مرز حقیقت و دروغ را از یکدیگر تشخیص دهیم.

طی روزها یا حتی ماههای گذشته، ممکن است بارها به ویدئوهای دیپفیک برخورده باشید؛ ویدئوهایی که اساساً هیچگونه انطباقی با حقیقت ندارند اما بهسبب واقعگرایانهبودنشان، نمیتوان متوجه جعلیبودن آنها شد. از سیاستمداران معروف تا هنرمندان مشهور و حتی مدیران مطرح دنیای فناوری، همگی در ماههای گذشته بهنوعی با این پدیده نوظهور دستوپنجه نرم کردهاند. از عکسهای غیراخلاقی و ساختگی هنرمندان مشهور بگیرید تا سخنرانیهای جعلی سیاستمداران و اظهارنظرهای طنزگونه مدیران فناوری درباره موضوعاتی نظیر حفظ حریم خصوصی، همگی نمونههایی کوچک از عملکرد تخریبگرایانه دیپفیک و اثر منفی آنها روی جامعه هستند.

اینطور که بهنظر میرسد، افق پیشروی دنیای فناوری بیش از آنچه فکرش را میکردیم، شبیه به وقایع سریال بلک میرر (Black Mirror) شده است؛ سریالی که روی تاریک پیشرفتهای فناوری را نشان میدهد.

فعلا نمیدانیم که آینده چهچیزی پیشرویمان میگذارد؛ اما اگر پدیده دیپفیک با سرعت فعلی، بدون محدودیت به پیشروی خود ادامه دهد، در آیندهای نزدیک با دنیایی تاریکتر از تصورات بدبینترین افراد مواجه خواهیم شد.

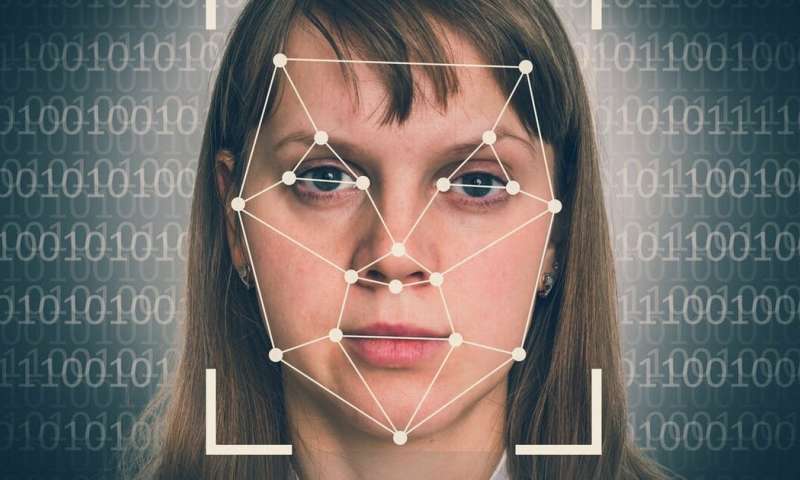

دیپفیک چیست؟

دیپفیک نام یک تکنیک نرمافزاری مبتنیبر هوشمصنوعی است که در محتوای صوتی و تصویری دست میبرد و آن را بهدلخواه دگرگون میسازد؛ بنابراین نتیجهی نهایی که بهدست میآید، چیزی کاملا متفاوت از حقیقت خواهد بود. درواقع نام این تکنیک نیز بهدرستی عملکرد آن را آشکار میسازد؛ دیپفیک، ترکیبی از یادگیری عمیق (Deep Learning) و جعل (Fake) است.

شاید عجیب باشد؛ اما کارگردانان سینما یکی از قدیمیترین استفادهکنندگان از این فناوری بودهاند. سِر پیتر کوشینگ، بازیگر انگلیسی که نقش «گرند ماف تارکین» را تا پیشاز مرگش در سال ۱۹۹۴ در مجموعه فیلمهای جنگ ستارگان بازی میکرد، باری دیگر در فیلم «روگ وان: داستانی از جنگ ستارگان» که مربوطبه سال ۲۰۱۶ میشود، ظاهر شد. در همین فیلم با استفاده از تکنیک مشابه، شخصیت «پرنسس لیا» هم بازسازی و جوان شد. در نمونهای دیگر، ستارهی فیلم «سریع و خشن»، یعنی پاول واکر را داریم که پیشاز تکمیل فیلمبرداری هفتمین قسمت از این سری در یک تصادف رانندگی درگذشت؛ اما بهلطف دیپفیک، هنوز شاهد هنرنمایی این بازیگر سری فیلمهای سریع و خشن هستیم.

درواقع این فناوری نیز برای ایجاد محتوای صوتی و تصویری متقاعدکننده و درعینحال غیرواقعی ساخته شده؛ یک فناوری که بهسرعت در حال رشد و بهبود است و انتظار میرود روزبهروز استفاده از آن گستردهتر شود. برنامههای ویرایش تصویر نظیر فتوشاپ، سالها کاری مشابه را ازطریق جعلکردن تصاویر انجام میدهند؛ اما چیزی که اکنون با آن روبهرو هستیم، مبحثی کاملاً متفاوت و نگرانکنندهتر از جعل عکس یک نفر در فتوشاپ است.

با پیشرفت خیرهکننده هوشمصنوعی طی سالهای اخیر، بسیاری از کارهایی که در گذشته سخت و ناممکن به نظر میرسیدند، ممکن شدهاند. پیشتر، کمتر کسی فکر میکرد که روزی بتوان محتوای یک ویدئو را بهطور کلی و بدون دخالت مستقیم انسان تغییر داد؛ اما اکنون دیپفیک ثابت کرده که چنین باوری در دنیای امروز جایی ندارد و بهراحتی میتوان ویدئوهایی تولید کرد که بهسبب واقعگرایانهبودن، بتوان میان حقیقت و دروغ آنها تمایزی قائل شد.

همانطور که بالاتر اشاره کردیم، دیپفیک یک تکنیک مبتنیبر هوشمصنوعی است؛ بنابراین نیازی به دخالت مستقیم انسان ندارد؛ ازاینرو، هرکسی ازطریق دیپفیک میتواند ویدئویی جعلی و درعینحال واقعگرایانه درست کند.

یکی از محبوبترین اهداف دیپفیک درطول دو سال گذشته، دونالد ترامپ، رئیس جمهور ایالات متحده آمریکا بوده است؛ کسی که دادههای صوتی و تصویری بسیاری از او در اینترنت وجود دارد. حال هر کس که به فناوری دیپفیک دسترسی داشته باشد، بهراحتی قادر به ساخت ویدئویی خواهد بود که دونالد ترامپ را در حال انجام کاری یا صحبتکردن دربارهی کاری غیرمعمول نشان میدهد.

دیپفیک چگونه ساخته میشود؟

چندین راه برای ساخت ویدئوهای دیپفیک وجود دارد؛ اما در تمام این راهها، شما باید مقدار زیادی از داده را به مدلهای یادگیری ماشین تغذیه کرد تا از این طریق محتوای جعلی تولید شود. واقعگرایانهترین نمونههای ساختهشده، حجم عظیمی از دادههای صوتی، تصویری و ویدئویی را طلب میکنند.

شاید برایتان عجیب باشد اما دیپفیک تنها در حوزههای بالا استفاده نمیشود و اپلکیشنی مانند اسنپچت نیز برای اعمال فیلترهای مبتنیبر چهره از چنین فناوری بهره میبرد. جلوتر که برویم، حتی اپلیکیشنهای قویتری در این زمینه وجود دارند؛ اپلیکیشنی مانند FakeApp که توسط توسعهدهندهای ناشناس ساخته شده و با استفاده از نرمافزارهای متنباز گوگل، به کاربران اجازه میدهد تا چهرهی خود را بهصورت واقعگرایانهای با دیگران جابهجا کنند؛ آن هم بدون اینکه دستکاریشدن ویدئو مشخص باشد.

احتمالاً فکر میکنید که چنین کاری نیازمند تبحر و مهارت بسیاری در علومهای کامپیوتری است؛ اما حتی افرادی که در حد انجام کارهای روزمره با کامپیوتر آشنایی دارند، میتوانند بهراحتی شیوهی کارکرد دیپفیک را یاد بگیرند و از آن برای اهداف خود استفاده کنند.